号称孵化 30 多个国产大模型的华为昇腾,究竟是何方神圣?

2023-05-22 19:16:57 | 来源:阿尔法工场 |

2023-05-22 19:16:57 | 来源:阿尔法工场 |

如果说,大模型是智能化时代的新型工件,那么昇腾 AI 则相当于制造了这些工件的 " 母机 " 或 " 车床 "。

【资料图】

【资料图】

5 月初,在鲲鹏昇腾开发者峰 2023 上,华为全面宣布升级鲲鹏开发者套件 DevKit 23.0,首批基于鲲鹏的一体化解决方案联合发布,而其中最瞩目的,莫过于孵化了众多国内大模型的昇腾 AI。

目前,基于昇腾 AI 已孵化和适配 30 多个主流大模型,超过一半的中国原生大模型基于昇腾 AI 孵化。

其中就包括了悟道大模型、鲲鹏大模型,鹏程系列、紫东系列等。

如果说,大模型是智能化时代的新型工件,那么昇腾 AI 则相当于制造了这些工件的 " 母机 " 或 " 车床 "。

它不仅可以生产和加工各种大模型,满足不同的需求和场景,还提供了大模型的训练、推理、优化、部署等全流程的能力。

那么,在大模型竞争日益激烈的今天,它的出现,对中国大模型的整体生态,又意味着什么?

今天,我们就试着从技术与商业应用两方面,详细谈谈昇腾 AI 对中国大模型的意义。

01 AI 时代心 " 底座 "

众所周知,大模型的训练、开发人工智能需要算法、算力和数据的积累,对于大多数实力并不雄厚的普通企业而言,这是一道难以逾越的技术门槛较。

如何让更多企业简单、便捷地开发自身的大模型,就成了人工智能得以落地化、产业化的关键。

而昇腾 AI 就是这种让 AI 实现 " 量产化 " 的 AI。

具体来说,它主要从以下几个方面,为大模型的研发和应用提供了支持。

硬件与算力

异腾 Al 基于华为自主研发的鲲鹏处理器和异腾加速卡,承载了海量数据的处理、超大模型的训练和推理。单卡最大提供 100 TOPS INT8 算力,为数据中心推理提供更强大支持。

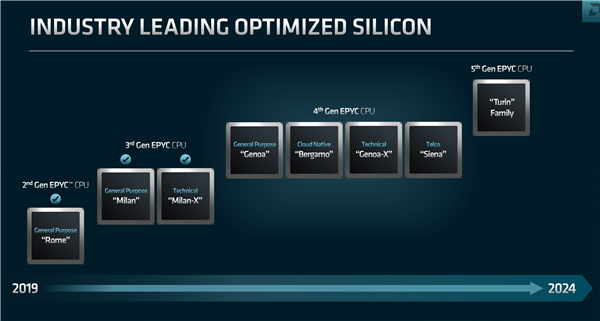

在 AI 芯片方面,昇腾系列 AI 处理器,是基于华为自主研发的 Da Vinci 架构设计的 AI 芯片。

目前主要包括了昇腾 910(用于训练)和昇腾 310(用于推理)两款处理器,采用自家的达芬奇架构。

基于昇腾系列 AI 处理器和基础软件构建 Atlas 人工智能计算解决方案,包括 Atlas 系列模块、板卡、小站、服务器、集群等丰富的产品形态,打造面向 " 端、边、云 " 的全场景 AI 基础设施方案,可以满足不同场景的大模型计算需求,例如:

昇腾 910,是一款面向云端和数据中心的高性能 AI 处理器,具有 256Tops@FP16 的算力,可以支持超大规模的 AI 训练任务,如自然语言处理、计算机视觉、推荐系统等。

而昇腾 310,则主打面向边缘场景的低功耗 AI 处理器,具有 16Tops@INT8 的算力,针对的应用场景也变为了视频分析、智能监控、智能驾驶等。

同时,昇腾系列 AI 处理器,还支持多种数据类型和精度,如 FP16、INT8、BF16 等,让用户可以根据不同的模型需求,进行灵活选择。

集群硬件上,昇腾 AI 全栈能力支撑全国 20 多个人工智能计算中心建设。其所属的 Atlas 800 AI 训练集群,是一款面向大模型训练场景的高性能 AI 集群,支持 8K 液冷集群,每台服务器内置 8 颗昇腾 910 AI 处理器,可以提供 2.24 PFLOPS 的超强算力,支持深度学习模型的快速开发和训练。

具体来说,它具有如下的特点:

高速网络带宽:每台服务器配备 8 个 100G RoCE v2 高速接口,实现芯片间跨服务器互联,降低时延和功耗。

超高能效:每台服务器最大功耗仅为 5.6 kW,单机支持风冷和液冷两种散热方式,提供 2.24 PFLOPS/5.6 kW 的超高能效比。

全场景 AI 计算框架:支持华为自研的全场景 AI 计算框架 MindSpore,兼容主流 AI 框架如 TensorFlow、PyTorch 等,提供丰富的算法库和工具包。

在集群训练的稳定性上,昇腾已经做到了 2 千亿参数大模型 25 天稳定训练至收敛。

软件架构

CANN 异构计算架构是昇腾 AI 的基础软件架构,提供了多维度混合并行、多层级存储优化、断点续训等能力,加速大模型的高效训练。

多维度混合并行是指在训练大模型时,利用多个昇腾 AI 处理器之间的协作,将模型和数据分割成多个部分,分别在不同的处理器上并行执行,从而提高训练效率和性能。

这就像是要烘焙一个很大的蛋糕,可以把蛋糕切成几块,分别放在不同的烤箱里烘焙,然后再把烤好的蛋糕拼接起来,这样就可以节省时间和空间。

多层级存储优化是指在训练大模型时,利用昇腾 AI 处理器上的不同层级的存储空间,根据数据的访问频率和重要性,将数据分配到合适的存储位置,从而提高数据的读写速度和效率。

CANN 异构计算架构还提供了统一的编程模型和运行时环境,支持多种 AI 框架和语言,兼容多种厂商硬件,实现软硬件协同优化。

MindSpore AI 框架是昇腾 AI 的全场景 AI 计算框架,提供了灵活的编程方式和丰富的算子库,支持业界主流社区模型套件,兼容第三方 AI 框架生态,为 AI 模型开发提供高效的编程体验。MindSpore AI 框架还提供了自动微分、自动并行、自动混合精度等能力,为大模型的训练提供更高的性能和效率。

MindStudio 开发工具链是昇腾 AI 的全流程开发工具链,提供了算子、模型、应用一站式高效开发和极简部署的能力,为 AI 模型开发提供便捷的开发工具。MindStudio 开发工具链还提供了性能分析、调试、故障诊断等能力,为大模型的训练提供更好的开发体验。

02 以应用赋能生态

除了强大的软、硬件基础外,昇腾 AI 之所以得以孵化超一半中国原生大模型,另一个重要原因,就是其丰富的应用使能、和开放的生态合作。

MindX 应用使能平台

具体来说,其所提供的 MindX 应用使能平台,提供了多个领域和场景的 SDK,并封装了华为在行业 AI 领域的基础算法和经验积累,目前包括制造质检、视觉分析、检索聚类、大模型微调等四个 SDK。

凭借着 SDK 提供的多种功能,用户不需要从零开始编写 AI 代码,而是直接调用 SDK 提供的简单易用的 API,就可以实现各种 AI 功能,从而实现了快速开发和部署 AI 应用。

此外,微调套件 SDK 还提供了多种微调算法和策略,如知识蒸馏、量化、剪枝等,为大模型提供了更高效和灵活的微调方式。

同时,MindX 应用使能平台还提供了 ModelZoo,一个基于昇腾 AI 处理器的预训练模型库,为用户提供了多个领域和场景的高质量预训练模型,让用户可以快速使用和微调大模型。目前已提供 20 多个模型,下半年将增加到 50 以上。

具体来说,它是通过提供大模型低参微调套件(MindSpore PET)来帮助用户快速使用和微调大模型的。

MindSpore PET 是一个基于昇思 MindSpore 的大模型低参微调套件,可以在不改变模型结构的情况下,通过少量参数的微调,实现模型在不同任务上的迁移学习。MindSpore PET 支持多种预训练模型,如 BERT、GPT-2、GPT-3 等,以及多种下游任务,如文本分类、文本生成、阅读理解等。MindSpore PET 还提供了一键式微调、评估、推理等功能,支持昇思高性能大模型。

这就像是用户想要一辆汽车(大模型),但是没有时间和精力去自己设计和制造。那么,用户就可以从 ModelZoo 中选择一辆已经优化过的汽车,它可以在昇腾 AI 的道路上高速行驶。

同时,用户还可以通过 MindSpore PET 对 " 汽车 " 的少量参数进行微调,比如换个颜色、加个音响、改个轮胎等。让它更适合自身的需要,而不需要花费太多的时间和精力。

开放的生态合作

除了通过 MindX 应用使能平台,提供各种应用场景外,昇腾 AI 在构建产业生态方面,也通过技术开放与合作,促成了产业的落地与应用。

目前,昇腾 AI 不仅开放了大模型技术平台,还与 UCloud、厦门文广、众数信科、南沙公控、CSDN 等伙伴共同推进大模型在各个行业的应用和落地。

例如,在电力行业,南方电网与华为签署了合作备忘录,携手推进人工智能在电力调度的创新应用。

双方将基于昇腾 AI 技术,针对电网当前动态出力和负载状况,实时做出更加经济和安全的调度决策和编排计划,同时助力机组出力分配最优化,促进电力现货交易的供需平衡,有效降低平均发电成本,进而提升整体运营效率和效益。

在智慧城市和数字政府领域,昇腾助力智慧龙岗 2.0 的打造。深圳市龙岗区政务服务数据管理局基于昇腾软硬件。

双方将利用昇腾 AI 提供的大模型技术和语音识别技术,在龙岗区政务服务中心打造 " 智慧窗口 ",实现语音自助查询、语音自助办理等功能,提高政务服务效率和便捷性。

而昇腾 AI 提供的大模型技术和图像识别技术,也将在龙岗区城市管理中心打造 " 智慧眼睛 ",实现城市环境监测、城市事件识别、城市事件处置等功能,提高城市管理水平和品质。

同时,通过建立大模型创新联合体,昇腾 AI 也打通了科研创新、应用示范到产业推广的通道,目前,昇腾 AI 已经成立了遥感、多模态、流体力学三个大模型产业联合体,吸引了 110 多家科研机构和企业加入,孵化了 80 多个行业新应用。

具体来说,昇腾 AI 为联合体成员提供了多维度的扶持政策和资金支持,例如昇腾 AI 为联合体成员赠送了昇腾 AI 硬件设备,提供了免费的 AI 算力资源,发放大模型研发补贴、大模型应用补贴等,帮助联合体成员加速大模型的研发和应用进程,降低项目风险和压力。

这些举措,都让联合体成员可以更容易地将大模型应用于各个行业领域,打造行业解决方案和典型案例,展示大模型的价值和效果。

同时使得联合体成员可以更广泛地将大模型推向市场,拓展商业渠道和客户群体,实现产业规模化和商业化。

03 总结

在 AIGC 时代,如果大模型只停留在实验室的层面,无法与真实的行业需求和应用场景相结合,那么它就会失去其存在的意义和价值。

这方面的反面教材,莫过于当年的 VR 技术。

VR 技术在应用落地过程中遭遇的困难,是技术瓶颈、内容缺乏、产业链不完善和应用环境的限制,这些困难导致了 VR 技术难以实现规模化应用和价值创造,最终成为了一阵风,而无法带动行业变革。

昇腾 AI 作为一种全栈 AI 计算基础设施,为大模型提供了从芯片到框架、从平台到应用的一体化解决方案,有效降低了大模型的开发门槛和成本,提升了大模型的性能和效率,促进了大模型的产业化和商业化。

昇腾 AI 这样的全栈 AI 计算基础设施,有效地解决了大模型所面临的技术瓶颈、市场障碍、生态缺失等问题,并让其实现了真正的落地和价值创造。

而只有通过产业落地和应用扩展,大模型才能真正发挥其优势,解决实际问题,创造社会效益和经济效益,推动人工智能技术的进步和创新,引领行业变革和发展。

关键词: