精彩看点:Yann LeCun:不在乎社会规范,ChatGPT 离真正的人还差得远

2023-03-12 20:10:17 | 来源:机器之心 |

2023-03-12 20:10:17 | 来源:机器之心 |

选自 noemamag.com

机器之心编译

机器之心编辑部

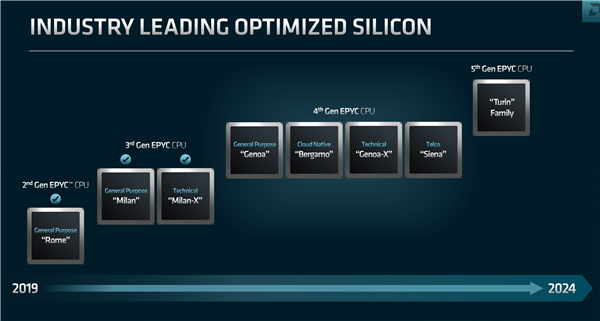

(相关资料图)

(相关资料图)

ChatGPT 虽能对答如流、花样百出,但离真正的人还差多远?深度学习三巨头之一的 Yann LeCun 等人撰文,对这一问题进行了深入探讨。

2022 年底 OpenAI 推出 ChatGPT,其爆火程度一直持续到今天,这个模型简直就是行走的流量,所到之处必将引起一番讨论狂潮。

各大科技公司、机构、甚至是个人,纷纷加紧研发类 ChatGPT 产品。与此同时,微软将 ChatGPT 接入必应,几乎前后脚,谷歌发布 Bard 为搜索引擎提供动力。英伟达 CEO 黄仁勋对 ChatGPT 给与了一个很高的评价,他表示,ChatGPT 是人工智能领域的 iPhone 时刻,也是计算领域有史以来最伟大的技术之一。

很多人对对话式 AI 已经到来深信不疑,但这类模型真的完美无缺吗?不见得,在它们身上总会出现一些荒诞的时刻(uncanny moments),例如随意发表不受约束的言论,或者喋喋不休地说出接管世界的计划等。

为了理解对话式 AI 这些荒诞时刻,由深度学习三巨头之一的 Yann LeCun 以及纽约大学计算机科学系博士后 Jacob Browning 等人联合撰写了一篇文章《AI Chatbots Don ’ t Care About Your Social Norms》,文中讨论了对话式 AI 的三个方面:聊天机器人、社会规范和人类期望。

文中谈到,人类非常善于避免口误,不让自己做出失误和失礼的言行。相比之下,聊天机器人却经常犯错。因此理解为什么人类擅长避免出错,可以更好的帮助我们理解目前聊天机器人为何不能被信任。

聊天机器人加入人类反馈,不让模型说错话

对于 GPT-3 来说,犯错的方式包括模型统计不准确。GPT-3 比较依赖用户提示,它对语境、情境等的理解只关注从用户的提示中可以得到什么。ChatGPT 也是如此,不过后者以一种新颖而有趣的方式稍作修改。除了统计学外,模型的反应也被人类评估员强化了。对于系统的输出,人类评估员会进行强化,使其输出好的反应。最终结果是,这个系统不仅会说一些貌似合理的东西,而且(理想情况下)还会说一些人类会判断为合适的东西——即便是模型说错了话,至少不会冒犯别人。

但这种方法给人的感觉太机械性。在人类对话中,有无数种方法可以说错话:我们可以说一些不恰当的、不诚实的、令人困惑的或者只是愚蠢的事情。我们甚至在说正确的事情时,由于说的语气或语调不对而受到指责。我们在与他人打交道的过程中,会穿越无数的「对话雷区」。控制自己不说错话不仅仅是对话的一个重要部分,它往往比对话本身更重要。有时,闭上嘴巴可能是唯一正确的行动方案。

这就引出两个问题:我们该如何驾驭模型这种不说错话的危险局面?以及为什么聊天机器人不能有效地控制自己不说错话?

对话该如何进行?

人类对话可以涉及任意话题,就像脚本化了一样:餐馆点餐,闲聊,为迟到道歉等等。不过这些不是文字脚本,中间充满了即兴创作,所以人类的这种对话模型才是更一般的模式,规则没有那么严格。

人类这种脚本化的言行不受文字制约。即使你不懂语言,同样的脚本也能发挥作用,比如打一个手势就知道对方想要什么。社会规范支配着这些脚本,帮助我们驾驭生活。这些规范规定了每个人在某些情况下的行为方式,为每个人分配了角色,并对如何行动给予了广泛的指导。遵循规范是有用的:它通过标准化和流程化来简化我们的交互,使彼此能更容易预测对方意图。

人类已经制定了惯例和规范来管理我们社会生活的每个方面,从使用什么叉子到在按喇叭之前应该等待多长时间。这对于在数十亿人的世界中生存至关重要,在这个世界上,我们遇到的大多数人都是完全陌生的人,他们的信仰可能与我们不一致。将这些共同的规范落实到位不仅可以使对话成为可能,而且会富有成果,列出我们应该谈论的内容——以及我们不应该谈论的所有事情。

规范的另一面

人类倾向于制裁那些违反规范的人,有时会公开,有时会秘密进行。社会规范使得评估一个陌生人变得非常简单,例如,在第一次约会时,通过对话以及提问等方式,双方会评估对方的行为,如果对方违反了其中一条规范——例如,如果他们表现得粗鲁或不恰当——我们通常会评判他们并拒绝第二次约会。

对人类来说,这些评判不仅是基于冷静的分析,更进一步的是基于我们对世界的情感反应。我们小时候接受的部分教育是情绪训练,以确保我们在对话中在正确的时间给出正确的情绪:当有人违反礼仪规范时感到愤怒,当有人说出冒犯性的话时感到厌恶,当我们说谎时感到羞耻。我们的道德良知使我们能够在对话中对任何不恰当的事情做出快速反应,并预测其他人将如何对我们的言论做出反应。

但不仅如此,一个违反了简单规范的人,他的整个性格都会遭到质疑。如果他在一件事情上撒了谎,那么会不会在其他事情上撒谎呢?因此,公开是为了让对方感到羞耻,并在此过程中迫使对方为自己的行为道歉(或至少为自身行为辩护)。规范也得到了加强。

简而言之,人类应该严格遵守社会规范,否则说出的话有很高的风险。我们要为自己所说的任何事情负责,所以要谨慎地选择说话,并希望周围的人也是如此。

不受约束的聊天机器人

人类对话的高风险揭示了什么让聊天机器人如此令人不安。通过仅仅预测对话如何进行,它们最终松散地遵守人类的规范,但它们不受这些规范的约束。当我们与聊天机器人随意交谈或测试它们解决语言难题的能力时,它们通常会给出一些似是而非的答案,并表现得像人类一样正常。有人甚至可能会将聊天机器人误认为是人。

但是,如果我们稍微更改 prompt 或者使用不同的脚本,聊天机器人会突然吐出阴谋论、种族主义长篇大论或胡说八道。这可能是因为它们接受了阴谋论者、喷子等在 Reddit 和其他平台写的内容的训练。

我们中的任何人都有可能说出像喷子一样的话,但我们不应该说,因为喷子的话充斥着胡说八道、冒犯性言论、残忍和不诚实。我们中的大多数人不说这些话,也是因为自己不相信它们。体面的规范已经将冒犯性行为推向了社会边缘,所以我们中的大多数人也不敢这样的话。

相比之下,聊天机器人不会意识到有些话是它们不应该说的,无论这些话在统计学上的可能性有多大。它们意识不到定义了该说和不该说之间界限的社会规范,也察觉不到影响我们使用语言的深层社会压力。即使聊天机器人承认搞砸并道歉了,它们也不明白为什么。如果我们指出它们错了,聊天机器人甚至会道歉以得到正确的答案。

这阐明了更深层次的问题:我们希望人类说话者能够忠实于他们所说的话,并且要求他们对此负责。我们不需要检查他们的大脑或了解任何心理学来做到这一点,只需要知道他们一贯可靠、遵守规范和行为上尊重他人,则会相信他们。聊天机器人的问题不在于「黑盒子」或技术不熟悉,而是因为长期以来不可靠和令人反感,并且没有努力改进甚至没有意识到存在问题。

开发人员当然知道这些问题。他们以及希望自身 AI 技术被广泛应用的公司担心自己的聊天机器人的声誉,并花大量时间重组系统以避免对话困难或消除不当回答。虽然这有助于使聊天机器人更安全,但开发人员需要竭力走到试图破坏它们的人的前面。因此,开发人员的方法是被动的,并且总是落后:有太多的错误方式无法预测到。

聪明但不人性化

这不应该让我们自鸣得意人类有多聪明,聊天机器人有多笨。相反,它们无所不谈的能力展现出了对人类社会生活和整个世界的深刻(或肤浅)的了解。聊天机器人非常聪明,至少能在测试中取得好成绩或提供有用的信息参考。聊天机器人在教育工作者中引起的恐慌足以说明它们在书本知识学习上令人印象深刻。

但问题在于聊天机器人不在乎(care)。它们没有任何想要通过对话实现的内在目标,也不受他人想法或反应的激励。它们不会因说谎感到难过,它们的诚实也不会得到回报。它们在某种程度是无耻的,甚至川普都非常关心自己的声誉,至少声称自己是诚实的。

因此,聊天机器人的对话是无意义的。对于人类来说,对话是获得我们想要的东西的一种方式,比如建立联系、在项目上获得帮助、打发时间或者了解一些东西。对话要求我们对对话的人感兴趣,理想情况下应该要关心对方。

即使我们不关心对话的人,至少在乎对方对自己的看法。我们深深地认识到,生活中的成功(比如拥有亲密关系、做好工作等)取决于拥有好的声誉。如果我们的社会地位下降,就可能失去一切。对话塑造了他人对我们的看法,并且很多人通过内心独白来塑造对自己的认知。

但是聊天机器人没有自己的故事可以讲述,也没有声誉可以捍卫,它们不像我们一样能感受到负责任行动的吸引力。聊天机器人可以并且在很多高度脚本化的情况下发挥作用,从玩地下城主、撰写合理的副本或者帮助作者探索思路,等等。不过它们缺乏对自己或他人的了解,无法成为值得信赖的社会代理人,即我们大多数时候希望与之交谈的那类人。

如果不了解有关诚实和体面的规范,也不关心自己的声誉,那么聊天机器人的用处就会受限,依赖它们也会带来真正的危险。

怪诞的对话

因此,聊天机器人并不是以人类的方式对话,并且它们永远不可能仅通过统计学上似乎可信的谈话达到目的。如果缺少对社会世界的真正了解,这些 AI 系统就只是无聊的话痨罢了,无论表现得多么机智或雄辩。

这有助于阐明为什么这些 AI 系统只是非常有趣的工具以及为什么人类不应该将它们拟人化。人类不仅仅是冷静的思考者或演说者,在本质上还是遵守规范的生物,通过共同的、强制性的期望在情感上相互建立联系。人类的思维和言语源于自身的社会性。

单纯的对话脱离了广泛的世界参与,与人类没有什么共同之处。聊天机器人不是像我们一样使用语言,即使它们有时说的与我们完全相同。可归根到底,它们不懂我们为什么这样说话,这是显而易见的。

原文链接:

https://www.noemamag.com/ai-chatbots-dont-care-about-your-social-norms/

探寻隐私计算最新行业技术,「首届隐语开源社区开放日」报名启程

春暖花开之际,诚邀广大技术开发者 & 产业用户相聚活动现场,体验数智时代的隐私计算生态建设之旅,一站构建隐私计算产业体系知识:

隐私计算领域焦点之性

分布式计算系统的短板与升级策略

隐私计算跨平台互联互通

隐语开源框架金融行业实战经验

3 月 29 日,北京 · 798 机遇空间,隐语开源社区开放日,期待线下面基。

关键词: